7月4日,2024世界人工智能大会暨人工智能全球治理高级别会议(WAIC2024)在上海开幕。在当天下午举行的国际电信联盟人工智能向善研讨会上,硅谷机器人创业公司Robust.AI首席执行官兼创始人加里·马库斯做了视频演讲,分享“如何确保人工智能为我们所用”。

加里·马库斯在论坛上进行视频演讲。 主办方供图

据澎湃新闻此前报道,加里·马库斯一直是生成式AI浪潮的唱反调者,坚称仅靠深度学习并不能实现类人智能,经常在社交媒体上与AI知名学者舌战。提起讨厌ChatGPT的专家,他绝对是社交媒体上最瞩目的人。

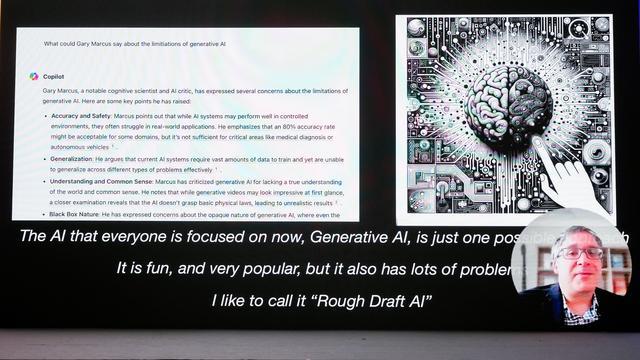

“现在所用的AI在技术上和道德上都是不完整的(inadequate)。”马库斯开篇明义,表示大家现在所关注的生成式AI只是一种可能性的方法,很有趣、很受欢迎,但是有很多问题,他更愿意将其称为“Rough Draft AI(AI的草稿)”。

马库斯将当前人们关注的通用人工智能称为“Rough Draft AI”

马库斯表示,AI会使用全世界的统计数据,试图从这些统计数据中猜测这个世界是如何运作的,但这并不能够代表世界的真相。这就是所谓的“AI幻觉”,大语言模型看起来很聪明,但是不能检查自己的工作。而这些问题并不能通过加入多模态、影像学工具来真正地解决。

其次,人工智能也会存在偏见问题,这在十年之前就为人们所知,但现在也还没有真正的解决方案。此外,人工智能也存在抄袭问题,Chat GPT的产出会根据统计数据给出多个版本的回答,但实际上只是已有数据的重塑。

由此,马库斯认为今天的AI是不稳定的,在现实中没有锚,于是带来很多风险,比如虚假信息、市场操作、诽谤、深度造假、偏见歧视、隐私数据泄露、侵犯知识产权等。在他看来,过度依赖这样不可靠的系统,甚至将AI工具放到武器系统或者电网当中,成本是巨大的,甚至可能会存在严重的长期风险。

如何在政策层面提出解法呢?马库斯指出,不能期待现有的法律面面俱到,也不能期待一个统一的解决方案能够解决AI带来的所有风险。在全球范围内,马库斯认为快速敏捷的反应很重要,同时还需要透明度,需要全面统计、全面训练,并全面披露所有内部测试。此外,还需要第三方来做发布后的审计,让人们知道这些AI系统是否被误用,是否存在歧视。要负责任地进行分层监督,要有类似国家和全球性质的机构来做监管。

马库斯还指出,不应该让大型科技公司来决定一切,例如技术开源可能会带来风险。

尽管AI热潮奔涌,但在马库斯看来,通用人工智能并非迫在眉睫。人们如此认为,一定程度上是来自硅谷的炒作,真正重要的是解决人工智能在现实世界中的问题。马库斯提出,人工智能的能力增长实际上已经放缓,但他仍觉得人工智能有希望变得更好。要实现这一点,还需要从人类社会当中获得线索。他说:“人的思维不是单一的,当我们在制定人工智能政策时,需要对当前的人工智能持现实的态度,并且找到超越它的方法。”

马库斯表示,很多公司都拥有学习能力强、推理能力较弱、数据不可解释的系统,而现在需要开发一种新的人工智能方法。或许需要几十年的时间,人们才能够去理解如何构建一个结合学习和推理优点的人工智能,让其成为可学习的、数据高效的、可解释的、可靠的、可验证的和基于事实的人工智能。